Publicaste 20 publicaciones. ¿Cuáles funcionaron realmente?

La respuesta corta

Las publicaciones que realmente funcionaron son las que superan a un grupo de comparación significativo. No es el promedio de la industria. No el año pasado. Las publicaciones de al lado, para el mismo cliente, en el mismo trimestre, en la misma plataforma. Sin esa vista en paralelo, los números de una sola publicación son ilegibles.

Agencias que tienen de 5 a 15 clientes siento que esto es más difícil que nadie, porque el trabajo de comparación se multiplica con cada cuenta. Este artículo describe tres patrones de comparación que convierten 20 publicaciones publicadas en decisiones que tu próxima llamada con un cliente realmente puede utilizar, y muestra por qué una vista en paralelo (como Comparación de resultados de ZoomSphere dentro de acciones masivas) reemplaza la reconstrucción de la hoja de cálculo de fin de mes que la mayoría de los equipos de las agencias temen silenciosamente.

{{form-component}}

El verdadero problema no es la medición. Es la brecha de comparación.

Todos los administradores de redes sociales con los que hablamos rastrean los números: alcance, impresiones, partidas guardadas, clics, seguidores. Los paneles nativos son de sobra, y la mayoría de los equipos exportan alguna versión de ellos a una hoja de cálculo al final del mes.

No es ahí donde las cosas se rompen. Se rompen en el siguiente paso: convertir filas de datos en una decisión.

Una publicación obtuvo 412 impresiones en LinkedIn. ¿Está bien? No puedes responder a la pregunta desde el propio número. Es bueno si es tu publicación de LinkedIn con mayor rendimiento de ese mes para ese cliente. Es malo que cuatro de las otras cinco publicaciones del cliente lo superen y esta sea la que más tiempo de producción consumió. El número por sí solo no dice nada. La comparación lo dice todo.

Esa es la brecha de comparación. Los equipos de las agencias miden publicación por publicación, cliente por cliente, luego se quedan mirando fijamente las filas y se sienten vagamente productivos, porque la hoja de cálculo está llena. Pero nadie se detiene a hacerse la única pregunta útil, la que hace que valga la pena tener la próxima llamada con un cliente: ¿comparado con qué?

La escala es lo que hace que esto sea tan doloroso en una agencia. Informe de referencia de informes de clientes de AgencyAnalytics descubrió que El 61,8% de las agencias extrae datos de 3 a 5 plataformas distintas por cliente, el 26,4% extrae de 6 a 10 y el 2,8% extrae datos de 11 o más. Las agencias inician sesión en esas plataformas por separado para cada cliente y cada ciclo de presentación de informes. Una cartera de 10 clientes implica repetir 10 veces el mismo ciclo de inicio de sesión, copiar, pegar y conciliar antes de que nadie tome una sola decisión. Y Encuesta de Sprout Social a 500 profesionales del marketing sitúa el coste semanal en 3,8 horas por semana dedicadas al análisis de datos y a la elaboración de informes, aproximadamente 16 horas al mes. La mayor parte de ese tiempo se dedica a la medición. Muy poco de esto es comparación.

Cómo comparar el rendimiento de las publicaciones en las redes sociales en todas las plataformas

Cuatro pasos, en este orden:

- Normalice la métrica. No compares la tasa de participación nativa de Facebook con la de TikTok. No son la misma fórmula. Convierte cada publicación en interacciones por cada 1000 impresiones (IPM) como número multiplataforma.

- Elige un grupo de comparación significativo. No son puntos de referencia de la industria. No el año pasado. Elige un grupo para este cliente, en esta plataforma, del mismo trimestre: los 5 primeros frente a los 5 últimos, las publicaciones de la campaña frente a las perennes, la versión A frente a la versión B.

- Alinéalas una al lado de la otra con vistas previas. Publica imágenes o miniaturas junto a las métricas. Sin la vista previa, no puedes ver los ganchos, los formatos ni los patrones visuales. Los números por sí solos no lo mostrarán.

- Pregunte qué comparten los ganadores y qué no comparten los perdedores. ¿Gancho? ¿Formato? ¿Día de la semana? ¿Longitud de los subtítulos? ¿Línea de apertura? La respuesta se convierte en una hipótesis de contenido para el próximo trimestre para ese cliente.

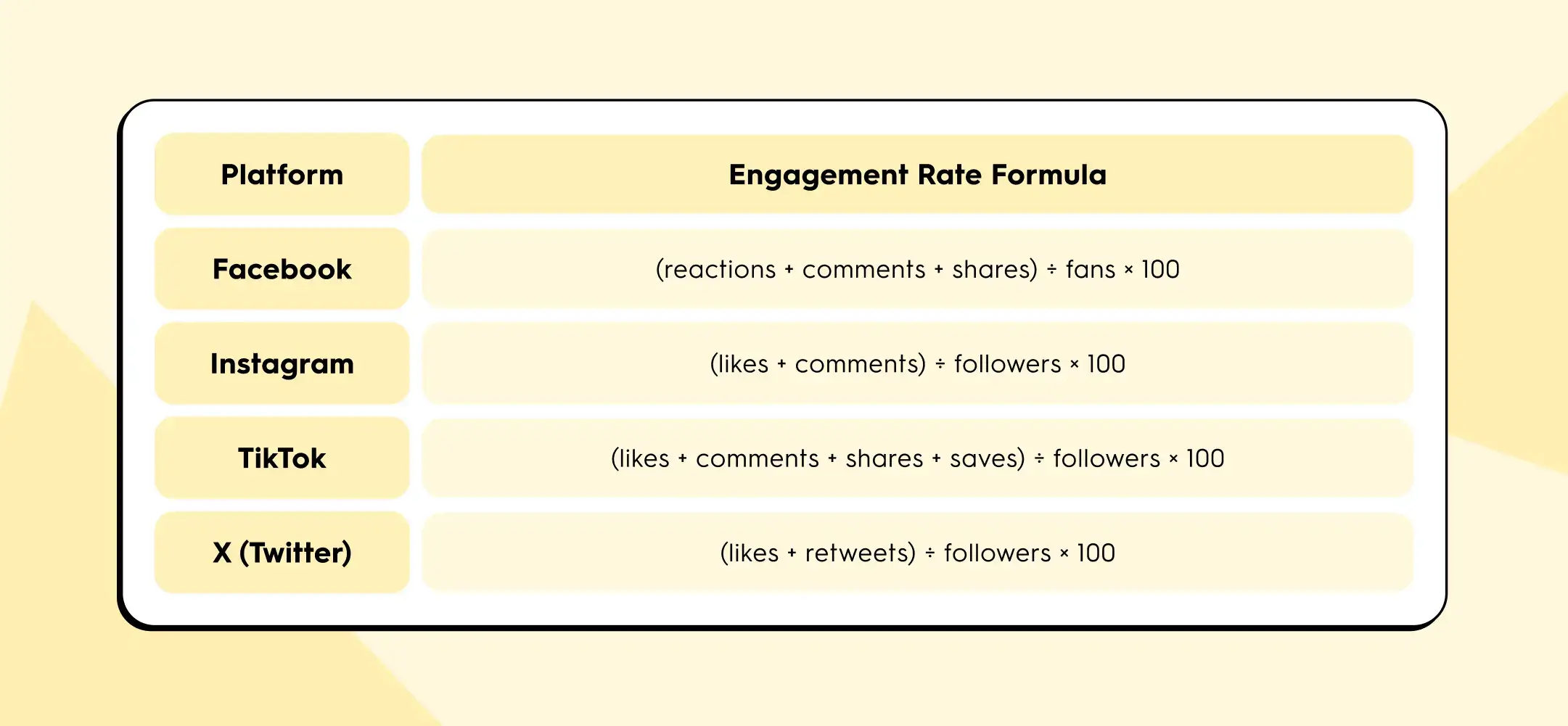

La trampa del paso 1 es que cada plataforma define la tasa de participación de manera diferente. De acuerdo con Metodología de puntos de referencia para 2026 de Socialinsider, las fórmulas tienen este aspecto:

Búferes Estado de la participación en las redes sociales 2026 añade otro detalle: la tasa de participación de LinkedIn incluye clics, mientras que la mayoría de las demás plataformas no lo hacen.

Si colocas los cuatro números en la misma fila de tu informe de cliente, no estás comparando el rendimiento del contenido. Estás comparando cuatro partes diferentes de la aritmética.

El IPM resuelve este problema porque las impresiones son el único denominador al que se exponen todas las plataformas y las interacciones (cualquier acción del usuario más allá de pasar el cursor) se pueden contar de forma coherente.

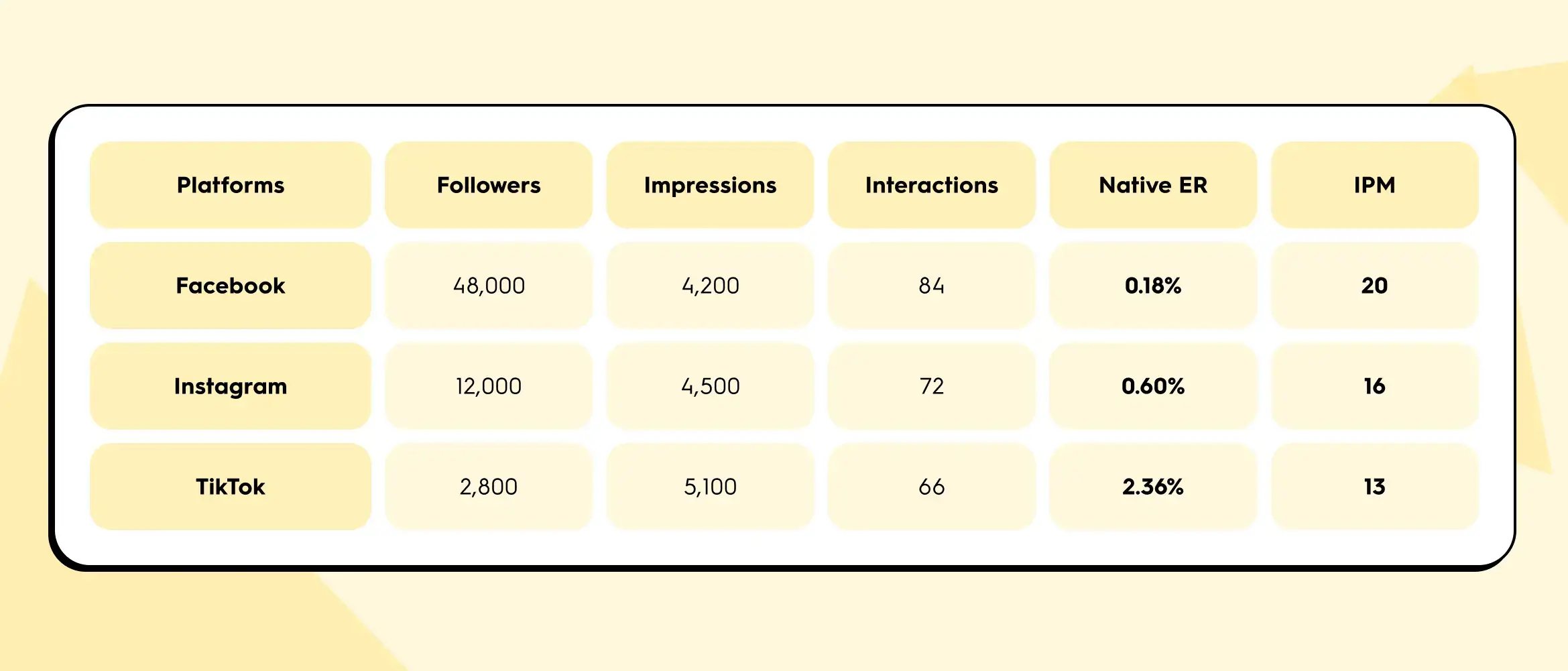

He aquí un ejemplo práctico. Un cliente de una agencia, una publicación de campaña, publicada de forma cruzada en tres plataformas:

La tasa de participación nativa sitúa a TikTok en primer lugar por una milla (el 2,36% frente al 0,18%). Pero IPM sitúa a Facebook en primer lugar. El desacuerdo no es un error de cálculo. La ER nativa está exagerada en TikTok porque el denominador de seguidores es pequeño. Por cada 1000 personas que realmente vieron el contenido, Facebook fue el que generó la mayor cantidad de interacciones.

Cuál importa depende de la pregunta que haga el cliente. Si la pregunta es «¿cuál de nuestros canales propios tiene la audiencia más fiel?», la sala de emergencias nativa de cada plataforma le brinda eso. Si la pregunta es «¿qué canal publicó realmente esta publicación?», IPM le da la respuesta honesta. Para las comparaciones multiplataforma dentro de un informe de cliente, el IPM es la métrica más segura. Para las líneas de tendencia de una sola plataforma a lo largo del tiempo, la ER nativa es adecuada. Un hábito útil para varios clientes: utiliza el IPM como el número de comparación estándar en todas las cuentas de la cartera y, a continuación, coloca debajo el ER nativo de la plataforma para mantener conversaciones específicas para cada plataforma.

Tres comparaciones que su informe mensual realmente necesita

En lugar de reportar números, reporte diferencias. Estos son los tres patrones de comparación que convierten un muro de datos en tres conversaciones útiles con los clientes.

1. Publicación multiplataforma: ¿qué canal publicó realmente el contenido?

Tu equipo escribió un artículo y lo publicó en Instagram, LinkedIn y Facebook para un cliente. En la mayoría de los informes, aparece como tres filas separadas con tres conjuntos de números distintos, y nadie comprueba si el mismo contenido tenía un rendimiento diferente en los tres canales.

Ahí es donde se esconde discretamente uno de los datos más valiosos de los informes mensuales. El mismo gancho, la misma copia, la misma imagen. Una curva de alcance diferente, una combinación de interacciones diferente, un comportamiento diferente al hacer clic. La historia no suele ser la de «una plataforma con un rendimiento inferior». La historia es qué plataforma es el canal de distribución de ese cliente, cuál es su canal de sensibilización y si su presupuesto de publicación cruzada se asigna en consecuencia.

No se puede ver sin una vista de lado a lado. Y en los paneles nativos, simplemente no existe una vista paralela de la misma publicación en tres plataformas.

2. Retrospectiva de la campaña: los 5 mejores contra los 5 últimos

Elige cualquier campaña del último trimestre, de cualquier cliente de la cartera. Cinco publicaciones relacionadas con un evento, el lanzamiento de un producto o una serie de contenido. Pon a los cinco jugadores más fuertes junto a los cinco más débiles y hazte una pregunta: ¿qué tienen en común los ganadores y qué no tienen los perdedores?

Por lo general, todo se reduce a una de estas cuatro cosas:

- el gancho

- el formato visual

- el día de la semana

- la longitud del subtítulo

No necesita un título en análisis para detectar el patrón. Necesitas tener las publicaciones delante de ti, en fila, para que tus ojos puedan hacer lo que las hojas de cálculo les impiden hacer de forma activa.

Esta es la forma más rápida de generar hipótesis de contenido para el próximo trimestre en todos los clientes que gestiones. También es la más difícil de realizar en una exportación de análisis estándar, porque la imagen de vista previa nunca aparece junto a los números. Sin la vista previa, estás conciliando los ID de las publicaciones en tu cabeza.

3. Prueba A/B: por qué, no solo qué

Tu equipo probó dos subtítulos para la misma imagen. Uno funcionó mejor que el otro. Está bien. La hoja de cálculo te dice cuál ganó, pero no te dice por qué.

Al ver los subtítulos uno al lado del otro, con los números debajo, es donde aparece el «por qué». Tal vez el subtítulo A comience con una pregunta y el subtítulo B comience con una estadística. La imagen era idéntica. El delta es la línea de apertura. Ahora tienes un principio reutilizable para las próximas 30 publicaciones, entre varios clientes de categorías similares, y no solo un ganador para este.

La vista previa del contenido junto a las métricas es lo que convierte una fila de datos en un aprendizaje.

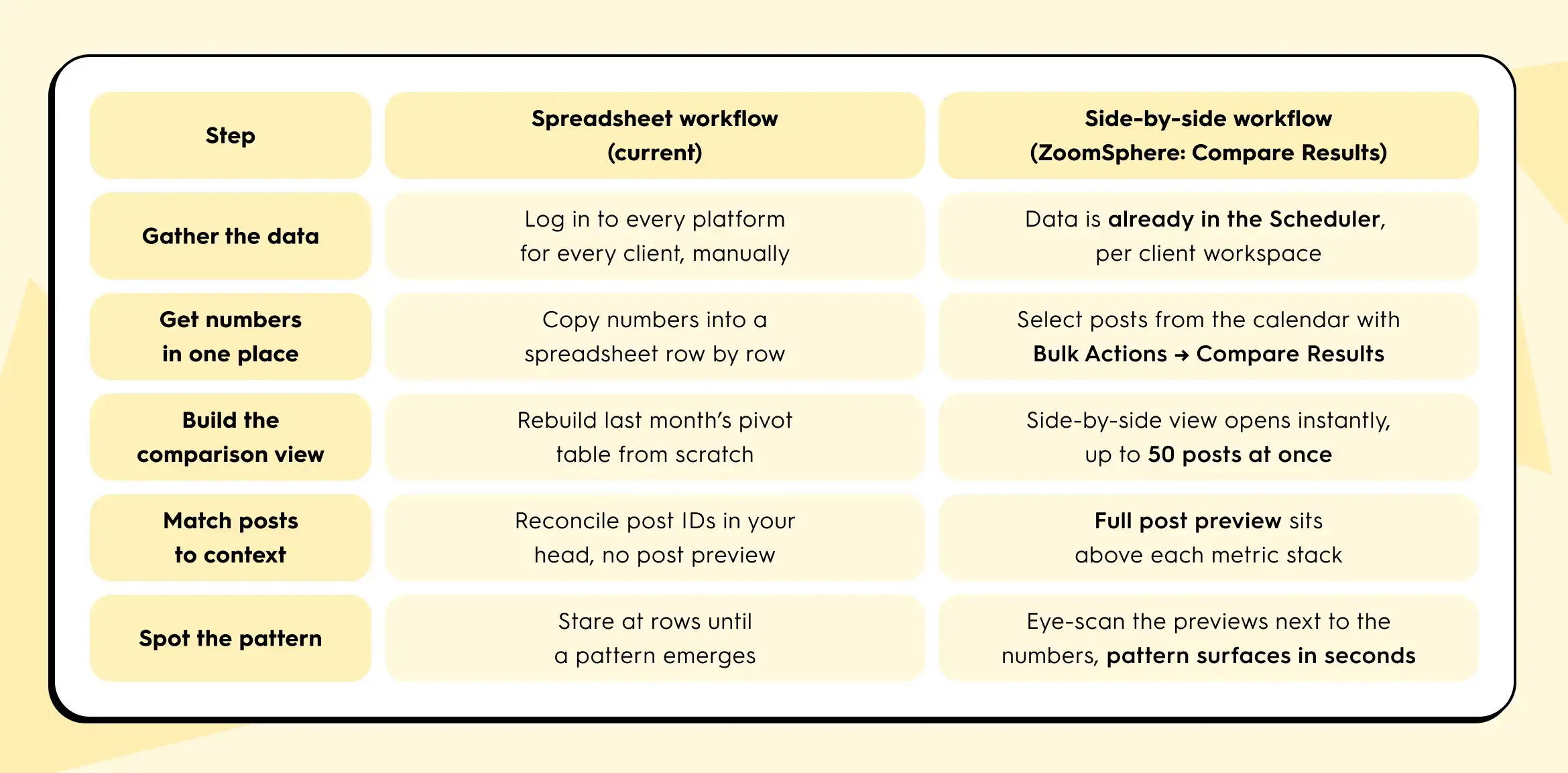

De la expansión de las hojas de cálculo a una al lado de la otra

La misma tarea, el mismo cliente, dos flujos de trabajo. Esto es lo que realmente cambia, paso a paso:

El enfoque lado a lado colapsa las primeras cinco filas en aproximadamente una vista. Aún escribes el informe al final. Pero la parte de reflexión y la parte de comparación ahora se realizan en minutos en lugar de horas, por cliente.

La reseña de 15 minutos del primer trimestre que realmente te dice algo

Estamos a finales de abril, lo que significa que el primer trimestre cerró hace tres semanas y la planificación del contenido del segundo trimestre figura en la agenda de esta semana, para todos los clientes de tu cartera.

No tendrás 60 minutos por cliente, solo 15. Esta es una reseña que se ajusta a ese bloque, desglosada primero entre las cuentas que más importan:

- Comience con sus tres clientes principales con mayores ingresos o mayor visibilidad. Abre la vista del calendario de los últimos 90 días para cada uno, uno a la vez.

- Selecciona los 5 mejores y los 5 últimos resultados según el alcance de ese cliente. Compáralos uno al lado del otro. Observe el patrón.

- Selecciona todas las publicaciones de la campaña más importante que el cliente haya realizado ese trimestre. Compáralas. Tenga en cuenta qué ganchos y formatos funcionaron.

- Selecciona cada versión de la publicación que se publicó de forma cruzada en varias plataformas para ese cliente. Compáralas. Observe qué canales realmente hicieron su parte.

Tres comparaciones por cliente. Quince minutos por cliente. Revisa la cartera en orden de prioridad hasta cubrir la semana de planificación. Cada llamada de planificación del segundo trimestre viene con tres afirmaciones específicas y defendibles sobre lo que funcionó y lo que no funcionó para ese cliente específico, basadas en pruebas paralelas. Esto supone pasar de «estos son los números» a «esto es lo que vamos a hacer de manera diferente para usted».

Qué aspecto tiene esto en su herramienta

En ZoomSphere, la comparación está integrada directamente en Planificador, no se incluye como un módulo de análisis independiente. Cada cliente vive en su propio espacio de trabajo, por lo que puedes pasar de una cuenta a otra sin tener que reconstruir el contexto. En el planificador de un cliente, seleccionas las publicaciones directamente del calendario usando Acciones masivas, luego elige Comparar resultados. La vista abre una tabla paralela con la vista previa de cada publicación en la parte superior y sus métricas (visualizaciones, alcance con desgloses orgánicos, virales y de pago, interacciones, clics, publicaciones guardadas y contadores específicos de cada plataforma, como los carretes, las jugadas y las repeticiones) apiladas en la parte inferior. Puedes comparar hasta 50 publicaciones reales a la vez.

Si la misma publicación llegó a varias páginas, canales o redes de Facebook, hay un segundo paso: busca la publicación, haz clic en el menú de tres puntos, selecciona Comparar resultados y verás esa publicación dividida en todas sus fuentes. Es la forma más rápida de responder a «¿La publicación cruzada realmente funciona para este cliente, o es una fuente la que lo publica todo en silencio?» pregunta.

Sin paso de exportación. Sin tabla dinámica. No puedes mantener el número anterior en la cabeza mientras abres otro panel nativo en otra pestaña.

Si tu herramienta actual no te permite alinear 5 publicaciones, 20 publicaciones o las publicaciones de una campaña completa una al lado de la otra en menos de un minuto, por cliente, esa es la brecha entre «medimos» y «aprendemos de las mediciones». Es la misma brecha que Sprout Social señala con 3,8 horas semanales: se dedican muchas horas a dibujar números y muchas menos a pensar que esos números deberían permitir.

Una cosa para probar esta semana

Antes de que comience la planificación del segundo trimestre, elija un cliente de su cartera. Consulte sus últimas 20 publicaciones publicadas. Elige cinco. Ponlos uno al lado del otro. Pregunte: ¿qué tienen en común los dos primeros que no tienen los tres últimos?

Esa es la pregunta que convierte una hoja de cálculo en una estrategia. Ya sea que lo hagas en ZoomSphere o en cualquier otro lugar, hazlo una vez para un cliente esta semana. Verás por qué seguimos hablando de ello.

Si quiere probarlo en ZoomSphere, ya está en su planificador en Acciones masivas → Comparar resultados.

{{cta-component}}

Respuestas rápidas para la comparación multiplataforma

Algunas preguntas que recibimos de los gerentes de las agencias cada vez que surge este tema.

¿Qué es el IPM (interacciones por cada 1000 impresiones)?

El IPM es una métrica de participación normalizada que se calcula como (interacciones ÷ impresiones) × 1000. Expresa el número de acciones de usuario que ha obtenido una publicación por cada 1000 visitas al contenido. Como las impresiones son el único denominador al que se exponen todas las plataformas principales, IPM te permite comparar directamente las publicaciones de Facebook, Instagram, TikTok, LinkedIn y X sin la falta de coincidencia en la definición que afecta a la tasa de participación nativa.

¿Por qué la tasa de participación es diferente en cada plataforma?

Cada plataforma define la tasa de participación con su propia fórmula. Facebook utiliza los fans como denominador y cuenta las reacciones, los comentarios y las veces que se comparte. Instagram usa seguidores y solo cuenta los me gusta y los comentarios. TikTok añade guardados. LinkedIn incluye clics. Cuando los colocas uno al lado del otro en un informe sobre un cliente, no estás comparando el rendimiento del contenido, sino cuatro cálculos aritméticos diferentes. Para tener una visión completa de todas las plataformas, usa IPM.

¿Cómo comparo el rendimiento de Instagram y TikTok para el mismo cliente?

Para un único contenido publicado de forma cruzada, calcula el IPM para cada plataforma: (interacciones ÷ impresiones) × 1000. A continuación, coloca las dos publicaciones una al lado de la otra con sus vistas previas por encima de las métricas. TikTok normalmente ganará con la tasa de participación nativa porque su denominador de seguidores es menor. IPM te ofrece una comparación honesta por cada mil impresiones. Añade el alcance, los archivos guardados y (cuando proceda) las veces que se comparte a continuación para leer la historia completa, no solo el número principal.

¿Cuántas publicaciones debo comparar a la vez?

Para detectar patrones, 5 contra 5 es el punto óptimo entre los mejores y los peores. Para ver las retrospectivas de la campaña, compara todas las publicaciones de la campaña (normalmente de 8 a 15). Para ver reseñas multiplataforma de una sola pieza, compara cada destino (de 2 a 4 plataformas). La vista de comparación de resultados de ZoomSphere incluye hasta 50 publicaciones reales una al lado de la otra, lo que cubre el equivalente a un trimestre completo de una campaña para un cliente sin dividir la visualización.

¿Cuál es la forma más rápida de detectar un patrón de publicación de alto rendimiento?

Alinee las 5 publicaciones principales y las 5 últimas de los últimos 90 días para un cliente, con vistas previas junto a las métricas. Pregunta qué comparten los ganadores y qué no comparten los perdedores. La respuesta casi siempre es una de estas cuatro cosas: el gancho, el formato visual, el día de la semana o la longitud de los subtítulos. No necesitas un título en análisis, necesitas las publicaciones en fila para que tus ojos puedan hacer el trabajo que una hoja de cálculo impide.

Heading 1

Heading 2

Heading 3

Heading 4

Heading 5

Heading 6

Lorem ipsum dolor sit amet, consectetur adipiscing elit, sed do eiusmod tempor incididunt ut labore et dolore magna aliqua. Ut enim ad minim veniam, quis nostrud exercitation ullamco laboris nisi ut aliquip ex ea commodo consequat. Duis aute irure dolor in reprehenderit in voluptate velit esse cillum dolore eu fugiat nulla pariatur.

Block quote

Ordered list

- Item 1

- Item 2

- Item 3

Unordered list

- Item A

- Item B

- Item C

Bold text

Emphasis

Superscript

Subscript

%20(1).webp)

%20(1).webp)

%20(1).webp)